2024-06-22 11:31:06

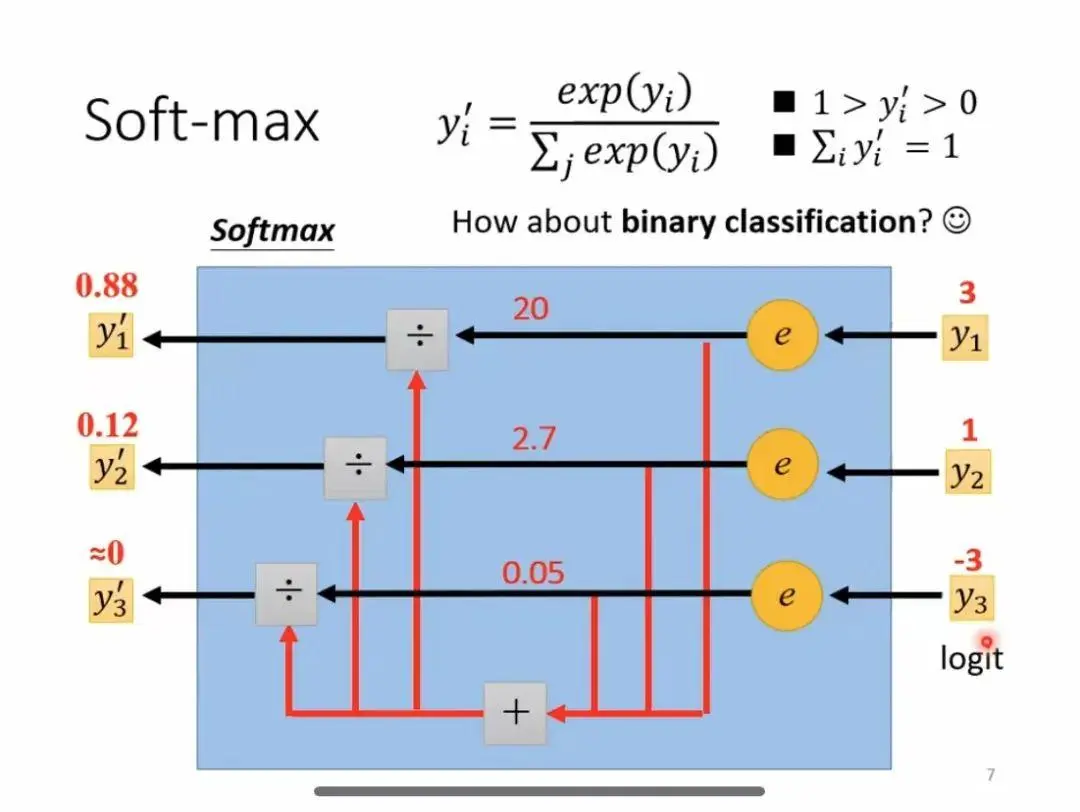

Softmax是一种常用的激活函数,主要用于多分类问题中,可以将输入的神经元转化为概率分布。ReLU的输出范围是[0,+∞),而输入值为负数时输出为0,这导致ReLU输出的分布不对称,限制了生成的多样性。Lea...

浏览 79 次 标签: AI 内容分享(十八):秒懂AI-深度学习四种常用激活函数:Sigmoid、Tanh、ReLU和Softmax

热门文章

- 北大荒:都重生了谁还回城?新书苏怀安秦灵在线阅读 大教授小说全文免费试读

- 浅浅顾言苏锦最新章节 3 胖茄子小说精彩章节在线阅读

- (番外)+(结局)真千金她一抬眸,海城大佬齐低头(沈幼梧厉北暝:完结+结局+番外)全文免费阅读无弹窗大结局_(真千金她一抬眸,海城大佬齐低头)最新章节列表_笔趣阁(沈幼梧厉北暝:完结+结局+番外)

- 主角霜珑 小说苏心妍薄靳言在线阅读 精品《苏心妍薄靳言》小说在线阅读

- 小说苏瑾年沈向东完整版在线阅读 大雪小说精彩章节在线阅读

- 【抖音】《浅浅顾言苏锦》胖茄子免费试读 小说全集免费在线阅读(胖茄子)

- 【抖音】小说苏瑾年沈向东无广告阅读 大雪小说全本无弹窗

- (无弹窗)小说崔瑶音沈云锦元安 作者太子退婚娶孤女后,悔疯了 (会跳舞的棉花糖)小说全集免费在线阅读

- (番外)+(全文)穿越海岛求生,我有空间小世界!君弑臣上官婉儿:全文+后续+结局(君弑臣上官婉儿)全文免费阅读无弹窗大结局_穿越海岛求生,我有空间小世界!:全文+后续+结局最新章节列表_笔趣阁(穿越海岛求生,我有空间小世界!君弑臣上官婉儿:全文+后续+结局)

名师推荐

- 无广告小说沐渐青云衔川 木宅在线阅读 (木宅)小说全集免费在线阅读

- 顾砚初宋雪音(宋雪音顾砚初)全文免费阅读无弹窗大结局_顾砚初宋雪音最新章节列表-笔趣阁宋雪音顾砚初

- 全网首发凤宁敖玄苍小说叫什么(敖玄苍凤宁)(凤宁敖玄苍)全书阅读纯净阅读

- 敖玄苍凤宁小说全篇完整在线阅读(凤宁敖玄苍)热门章节列表

- (完整版未删节)小说敖凡青云子 第2章 爱吃辣的小子小说精彩章节在线阅读

- 秦心宁秦泽安by时间向前,回忆消散 第一章 秦心宁秦泽安小说全文在线阅读

- (独家)魏迟沈梨小说 回风流玉小说精彩章节在线阅读

- 柳欣欣茜茜完整版在线阅读(主角开心二马) (开心二马)小说全集免费在线阅读

- 真千金她一抬眸,海城大佬齐低头(沈幼梧厉北暝)抖音热推小说全集无删减_(沈幼梧厉北暝免费阅读全文大结局)最新章节列表_笔趣阁